Noticias

<< Volver al listado de noticias

Los Expertos Opinan - "Coches Autónomos, Accidentes y Ciberseguridad" - Francisco Lázaro Anguís

Publicado el 10-04-2018 Notícia sobre: Artículos|

|

|||||||

|

"Coches Autónomos, Accidentes y Ciberseguridad"

En el mes que ha pasado a ser obligatorio el sistema e-call en todas las comercializaciones de los vehículos, la conducción autónoma ha tenido dos accidentes mortales. |

|||||||

El e-Call funciona mediante diversos sensores instalados en el vehículo, una tarjeta SIM virtual y localización por satélite y avisará al 112 de forma automática o manual. Los datos que comparte el sistema no son otros que la localización exacta, el tipo de combustible y el número de pasajeros. Los vehículos equipados con este dispositivo no deben poder ser rastreados y la propia normativa europea establece que “los datos de la memoria interna de dicho sistema o unidad técnica independiente se supriman de forma automática y continuada, y que ninguna entidad exterior al sistema o a la unidad técnica independiente integrados en el vehículo tenga acceso a dichos datos antes de que se active la e-Call”. La conducción autónoma frente a las innovaciones que se van incorporando a la conducción asistida, comportará un salto cuantitativo que esperemos no sea traumático.

VISION OPTIMISTA DE LA CONDUCCIÖN AUTONOMA.

Actualmente, 9 de cada 10 accidentes en la carretera tienen su origen en un error humano según datos de la Fundación Española para la Seguridad Vial (Fesvial). ¿Puede ser el vehículo autónomo la solución a este problema?

En el 2017 el resultado de la pregunta ¿te ves en un coche autónomo antes de próximos cinco años? reflejó que el 55 % de los jóvenes encuestados respondieron afirmativamente. En el 2016 otra encuesta nacional aportó que un 44% desconfía de la capacidad de un coche para conducirse a sí mismo y un 33% de los encuestados asegura que se fiaría totalmente para llevar a sus hijos al colegio, nueve puntos porcentuales por debajo del 42% que aseguraba, antes de plantearse una situación específica, que el coche autónomo será tanto o más seguro que uno conducido por humanos.

Las estimaciones actuales de la UE cifran como un beneficio de la conducción autónoma, una reducción del 10% de fallecidos en accidentes de tráfico y una reducción del 90% de los accidentes. Sin embargo, si tenemos en cuenta el muy escaso número de vehículos de este tipo que están circulando, Marzo no ha sido un buen mes para la conducción autónoma; se ha cerrado con dos víctimas: un peatón y un conductor.

PRIMERAS VICTIMAS MORTALES

El pasado día 19 de Marzo del 2018 un SUV de UBER en conducción autónoma mató, atropellando a un peatón que cruzaba la calle por una zona sin paso de peatones.

Las imágenes del conductor (llamado en este caso “conductor de seguridad”), grabadas desde el interior del vehículo, no dejan lugar a dudas de su actitud relajada, el cual probablemente estaba leyendo de forma intermitente mensajes de su móvil.

El peatón, no ha sido la primera víctima relacionada con un vehículo en conducción autónoma; el 7 de Mayo del 2016, el conductor de un Tesla model S perdió la vida, mientras veía una película de Harry Potter.

En el momento del atropello, las imágenes del exterior del vehículo muestran una carretera muy mal iluminada y en mi opinión un vehículo con poca capacidad luminosa, por lo que cuando en la grabación se ve al peatón ya está literalmente encima del vehículo. Esta aparición abrupta es lo que a los partidarios de la tecnología les lleva a pensar “qué aún con un conductor activo habría pasado lo mismo”.

.png)

Sin embargo, otros usuarios han subido grabaciones de la misma calle, en el mismo sitio del atropello y a la misma hora, está mucho más iluminada, lo que hace dudar de las imágenes difundidas desde el vehículo (ver la imagen de la misma calle en dos grabaciones diferentes).

Quizás no esté demás recordar que los vehículos autónomos entre su arsenal de sensores disponen de sensores de infrarrojos precisamente para mejorar la detección en situaciones de baja luminosidad. En este accidente, el vehículo no detecta la presencia de un humano y un objeto de metal, una bicicleta. El lidar, la pieza láser objeto de disputa legal entre Uber y Google por copia de patentes, tiene precisamente ese cometido, detectar y analizar en tiempo real lo que sucede a su alrededor.

Uber, tras el atropello ha paralizado las pruebas hasta tener más información. No es la primera vez que lo hace; por ejemplo, cuando inició las pruebas sobre tráfico real en San Francisco tuvo que aparcar su flota de Volvo XC90 (como el del atropello) por saltarse algún que otro semáforo.

.jpg)

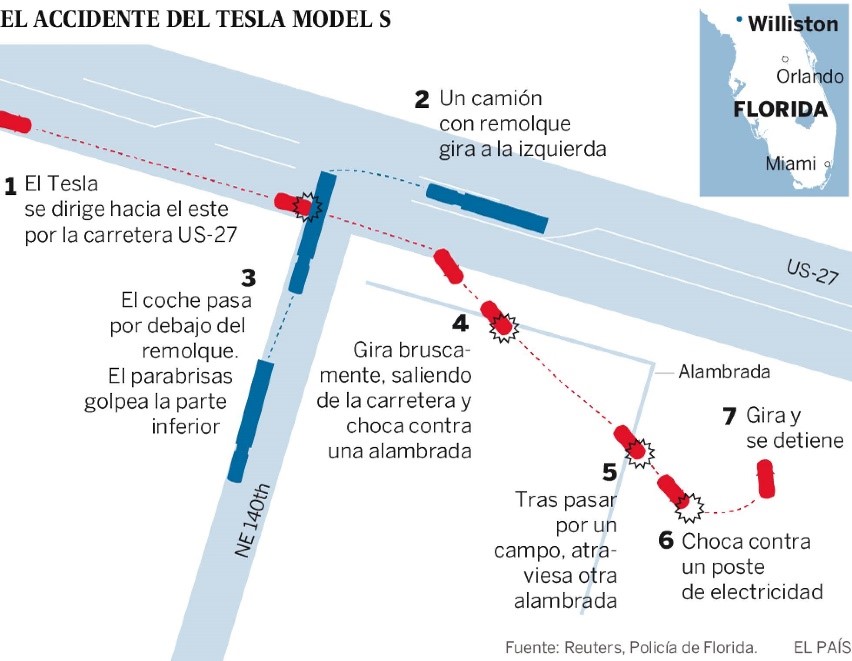

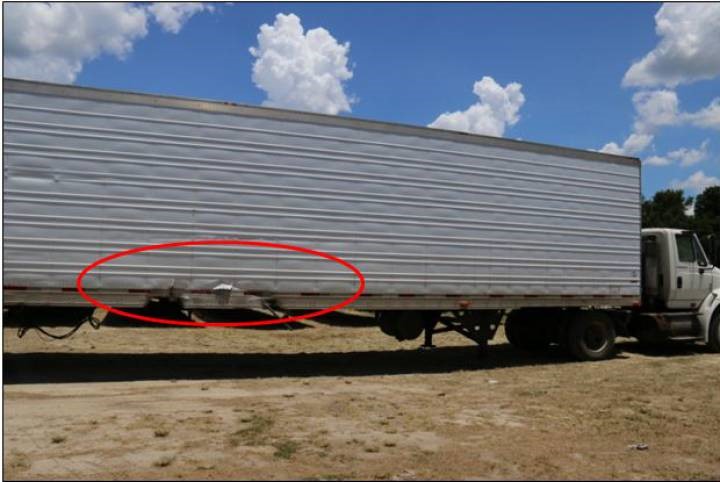

Si nos remontamos al primer accidente mortal del tesla , este tuvo lugar cuando un camión hizo un giro a la izquierda y el Tesla no frenó , pasando por debajo del trailer.. Esto ocurrió porque la inteligencia del vehículo no distinguió el camión del horizonte; al confundir el color del tráiler con el horizonte El coche siguió en la autovía hasta que chocó con una valla. Brown, conductor pasivo que había delegado en el piloto automático del coche perdió la vida al momento.

ALGUNOS ACIDENTES EN LOS QUE SE HAN VISTO INVLUCRADOS LOS VEHICULOS AUTONOMOS.

Cómo es lógico los vehículos autónomos se han visto inmersos en varios accidentes y no tiene sentido hacer una relación extensa de los mismos, pero si es interesante ver los que a nuestro juicio visualizan diferentes tipos de problemas tecnológicos que deben ser destacados.

- TRAZABILIDAD: En enero 2016, se produjo un accidente de un Tesla en China con un muerto en el que se vio involucrado uno de sus vehículos con piloto automático, al “comerse” literalmente un camión. La compañía aseguró en un comunicado en septiembre de ese mismo año qué no tenía manera de saber si el dispositivo estaba conectado en el momento del siniestro. Tesla motor dio a conocer la información preliminar del accidente que había sucedido seis meses antes, dos días después de que la empresa anunciase una actualización de su sistema de piloto automático para mejorar la seguridad de sus coches autopilot.

- REGLAS HUMANAS EN LA INTELIGENCIA ARTIFICIAL: En Marzo del 2016 un coche en pruebas de google en Mountain View, vio bloqueado su carril por unos sacos de arena situados en un colector de agua. El Lexus RX450h con tecnología Google decidió entonces incorporarse al carril central. Aunque dejó pasar varios coches antes de proceder a la incorporación, la decisión de la IA del coche autónomo de Google fue incorrecta y en el momento de comenzar la maniobra golpeó con su parte frontal izquierda contra el lateral de un autobús que realizaba una de las rutas programadas en el sistema de transporte público de la población. El incidente fue leve ya que el Lexus RX450h apenas circulaba a 3 kilómetros por hora, mientras que el autobús no superaba los 25 kilómetros por hora. Google reprogramó el software para que su vehículo tengan más cuidado con los vehículos de gran tamaño. “Nuestro conductor, que estaba mirando al autobús llegar desde el espejo retrovisor, también esperaba que el bus bajara la velocidad o se parara. Imaginamos que el conductor del bus pensaría que nos íbamos a quedar parados esperando. Este tipo de malentendidos ocurren entre conductores humanos todos los días. Claramente tenemos parte de responsabilidad”.

- INTEGRACIÓN Y RESPONSABILIDAD: El 19 de Marzo del 2018, se produce el atropello en el que el vehículo autónomo no detectó ni a la mujer ni a la bicicleta. El vehículo iba dotado con los sensores de Volvo y los que Uber dotó al vehículo. Aptiv, la empresa que proporciona a Volvo las cámaras y radares que se utilizan en sistemas de seguridad como el sistema de detección de peatones, se ha desmarcado y ha asegurado que sus sistemas estaban desactivados la noche del accidente. MobilEye, una empresa de Intel cuya tecnología es parte fundamental del paquete que Aptiv entrega a Volvo, también ha querido desmarcarse del accidente. En una nota publicada por el mismo CEO de la marca, Amnon Shashua, en la web de Intel asegura que, según una prueba, sus sistemas detectaban a la mujer un segundo antes del impacto incluso teniendo en cuenta que la calidad del vídeo emitido por la policía de Tempe no sea la mejor. Los sistemas de MobilEye, como los de Aptiv, estaban desactivados. la CEO de Velodyne Lidar Inc, productores del radar láser que utilizan los sistemas de Uber, aseguró estar totalmente desconcertada en declaraciones a Los Angeles Times. "Nuestro radar es capaz de detectar claramente a Elaine y su bicicleta en esa situación. Sin embargo, nuestro radar no decide si accionar los frenos o no", escribió en un mail para el rotativo californiano. "Además, los sistemas autónomos tienen varios sensores, incluyendo una cámara y un radar para tomar decisiones. No sabemos qué sensores había en el coche de Uber esa noche, si funcionaban o cómo estaban siendo usados", añadía la ejecutiva.

- USO INADECUADO DE LA TECNOLOGÍA (RELAJACIÓN): Marzo del 2018 el Tesla Model X tenía activado el sistema de conducción automática en el momento del choque, ocurrido en la carretera 101 de Mountain View, California. Además, según añade la compañía de Elon Musk, el conductor no actuó en el momento del accidente pese a recibir reiterados avisos por parte del coche de que pusiera las manos sobre el volante. "El conductor contaba con unos cinco segundos y 150 metros de visibilidad antes de chocarse, pero los registros del vehículo muestran que no se llevó a cabo ninguna acción por parte del conductor", aseguran. El comunicado emitido por la compañía no señala por qué el sistema de conducción automática no pudo detectar el muro de hormigón (mediana) contra el que se acabó estrellando el coche.

Dejando al margen que el vehículo en conducción autónoma se estrelló contra la mediana el fabricante le da al conductor un estrecho margen para usar su tecnología como está regulado; cinco segundos para pasar de estar relajado, como los anuncios nos muestran, a una actitud expectante como el manual indica.

PRUEBAS

La necesidad de recorrer muchos kilómetros de forma controlada forma parte del entrenamiento para hacer que sus patrones de reconocimiento funcionen de inmediato, no como sucede en esos casos . Hace justo un año UBER publicó una información sobre los avances en sus pruebas en la que los humanos tuvieron que tomar el control durante la conducción una vez cada dos kilómetros de media. Las razones van desde subsanar un error técnico hasta evitar un accidente o una infracción de tráfico.

Las intervenciones humanas que fueron necesarias se categorizaron haciendo una diferenciación en tres niveles: las intervenciones en las que no existe peligro, las desconexiones críticas (del sistema autónomo) para evitar incidentes y las que denomina "malas experiencias", como frenazos bruscos o giros repentinos.

Uber publicó sus avances: durante las pruebas por una avenida con varios carriles en el centro de la ciudad, el coche autónomo de Uber fue capaz de viajar durante cerca de 1 kilómetro sin intervención humana y a lo largo de 3,2 kilómetros sin una "mala experiencia". La experiencia en la otra ruta, que discurrió por la Universidad de Arizona, fue descrita como un "fuerte avance": el vehículo viajó un total de 722 kilómetros en modo autónomo sin una intervención crítica y a lo largo de 11 kilómetros sin una "mala experiencia".

La nota positiva se encuentra en la mejora de las desconexiones "críticas": pasaron de darse una vez cada 201 km en el mes de enero a una cada 315 km en marzo del 2017.

El vehículo autónomo se construye sobre los siguientes principios esenciales:

Potenciar las capacidades de percepción para marcar el ritmo en el sector, dotar de los algoritmos e inteligencia artificial que doten de una conducción autónoma segura, integrar los dispositivos en el diseño del propio vehículo con una imagen que resulte elegante e incorporar la tecnología de conducción automatizada de manera que sea fácil de replicar en una flota de automóviles.

MODOS DE CONDUCCIÓN AUTONOMA; SCALA SAE Y NHTSA.

Cuando se habla de los modos de conducción autónoma, parece que todo está muy reglado y que el paso de uno a otro debe conllevar una “configuración” pero lo cierto es que en los niveles altos es la actitud del conductor el que determina en qué grado desarrolla el vehículo la conducción. Por ejemplo, en el caso de Tesla, pagando el nivel de software adecuado, los vehículos salen con la capacidad total, si bien se han ido añadiendo protecciones conformen han ido teniendo accidentes.

Según las previsiones, los coches sin conductor en España podrían ser una realidad entre 2020 y 2030. Estamos hablando del nivel 5 de conducción autónoma, en una escala del 0 al 5, siendo 0 conducción manual y 5 la automatización total (según la escala de SAE, Sociedad de Ingenieros Automotrices por sus siglas en inglés, adoptada como la estándar). Conviene, por lo tanto, conocer en qué se diferencia cada uno de los niveles de conducción.

En la actualidad, en España podemos encontrar prototipos autorizados de niveles 3 y 4. Pero debemos dejar claro que lo autorizado refleja un tema legal y no lo que técnicamente es real.

Además de la mencionada escala del 0 al 5 del SAE, en otras ocasiones se habla de otra graduación; la NHTSA, el organismo de seguridad vial de Estados Unidos (el equivalente a la DGT en España), en la que los niveles de conducción van del 0 al 4. El 0 se refiere a la conducción manual, y el 4 a un nivel totalmente automatizado.

PROBLEMATICAS A TENER EN CUENTA

- Cambios en la Legislación.

- Responsabilidad en caso de accidente

- Pérdida de la privacidad

- Cambios en la Seguridad vial

- Ciberseguridad. Protección frente a ataques

- Fallos en el sistema

- Actualizaciones de software

- Cambios en las infraestructuras.

- Alto nivel de mantenimiento

- Costes e integración en cadena de producción

CIBERSEGURIDAD

Los principales riesgos a los que nos enfrentamos (y no solo los vehículos autónomos sino la ciudadanía en general) son ataques a lo que llamamos sistema core del vehículo (sensores, radar, gps, inteligencia, comunicaciones exteriores e interiores, frenos, motor…), robo de información personal o secuestro o bloqueo del vehículo. En todos estos casos, el intruso podría pedirnos dinero a cambio de recuperar el control, pero lo que es peor causar daños a personas,

Formarán parte de los ataques aquellos que se realicen contra las comunicaciones ntre vehículos inteligentes y las infraestructuras que le den soporte.

Desde el año 2014 se vienen sucediendo las pruebas de concepto de ataques sobre vehículos conectados, en el 2015 fueron especialmente difundidas las del Jeep Cherokee , que provocaron la revisión de 1,4 millones de vehículos.Los ataques a vehículos conectados se han realizado con punteros laser o cintas en las señales.

La Asociación de Constructores Europeos de Automóviles (ACEA) y sus 14 compañías miembro han identificado un paquete conformado por seis "principios clave" de ciberseguridad para la industria de la automoción: generar cultura en ciberseguridad, adoptar un ciclo de vida de ciberseguridad para la fabricación de vehículos, evaluar las funciones de seguridad a través de distintas fases de prueba, crear una política actualizada de seguridad y mejorar el intercambio de información entre los actores del sector.

Google ha anunciado que sus coches estarán desconectados de Internet la mayor parte del tiempo para evitar pirateos y Audi ha creado un laboratorio de seguridad dedicado a investigar cualquier posible grieta de los sistemas del vehículo que pueda ser aprovechada por los hackers. Pero todos estos esfuerzos se nos antojan aun cortos y más cuando leemos declaraciones como las que un directivo español de una asociación muy relacionada con los fabricantes dio a un periódico nacional:“Si estás conectado, puedes ser vulnerable. Pero estar conectado no es sinónimo de ser vulnerable, el cual aseguraba (¡menos mal!) que los productores de coches ya tienen alianzas con empresas tecnológicas para elaborar sus sistemas de seguridad.

Carlos Sahuquillo (GMV) , en una entrevista a “El Pais” describió muy certeramente uno de los problemas principales: “Cuando un fabricante desarrolla un nuevo componente para sus coches, por ejemplo unos discos de freno, tarda un mínimo de cinco años hasta que llega al mercado, ya que se realizan múltiples pruebas. Pero ahora los vehículos incluyen tecnología que no se puede probar durante tanto tiempo, ya que si no, cuando llegara a los coches de los concesionarios, ya estaría obsoleta”.

.png)